AlexNet (Krizhevsky et al., 2012) は、Hinton 教授らのチームによって発表された物体認識のためのモデル(アーキテクチャ)である。AlexNet が、物体認識のために、初めて深層学習の概念および畳み込みニューラルネットワークの概念を取り入れたアーキテクチャである。当時の画像分類チャレンジコンテスト(ILSVRC)において、AlexNet が飛躍てきな性能を果たした。

2012 年前までの画像分類チャレンジコンテストにおいて、画像から特徴量を抽出し、その特徴量を用いて画像の分類を行なっていた。当時、画像から特徴量を抽出する際に、人が、物体の色・輝度・形など特徴量を設計していた。そのため、いかに有効な特徴量を設計できることが、画像分類の性能を左右していた。それが、2012 年に、人が特徴量を設計しなくても、十分なデータさえ存在すれば、機械自身が特徴量を見つけ出すことが AlexNet によってで示された。

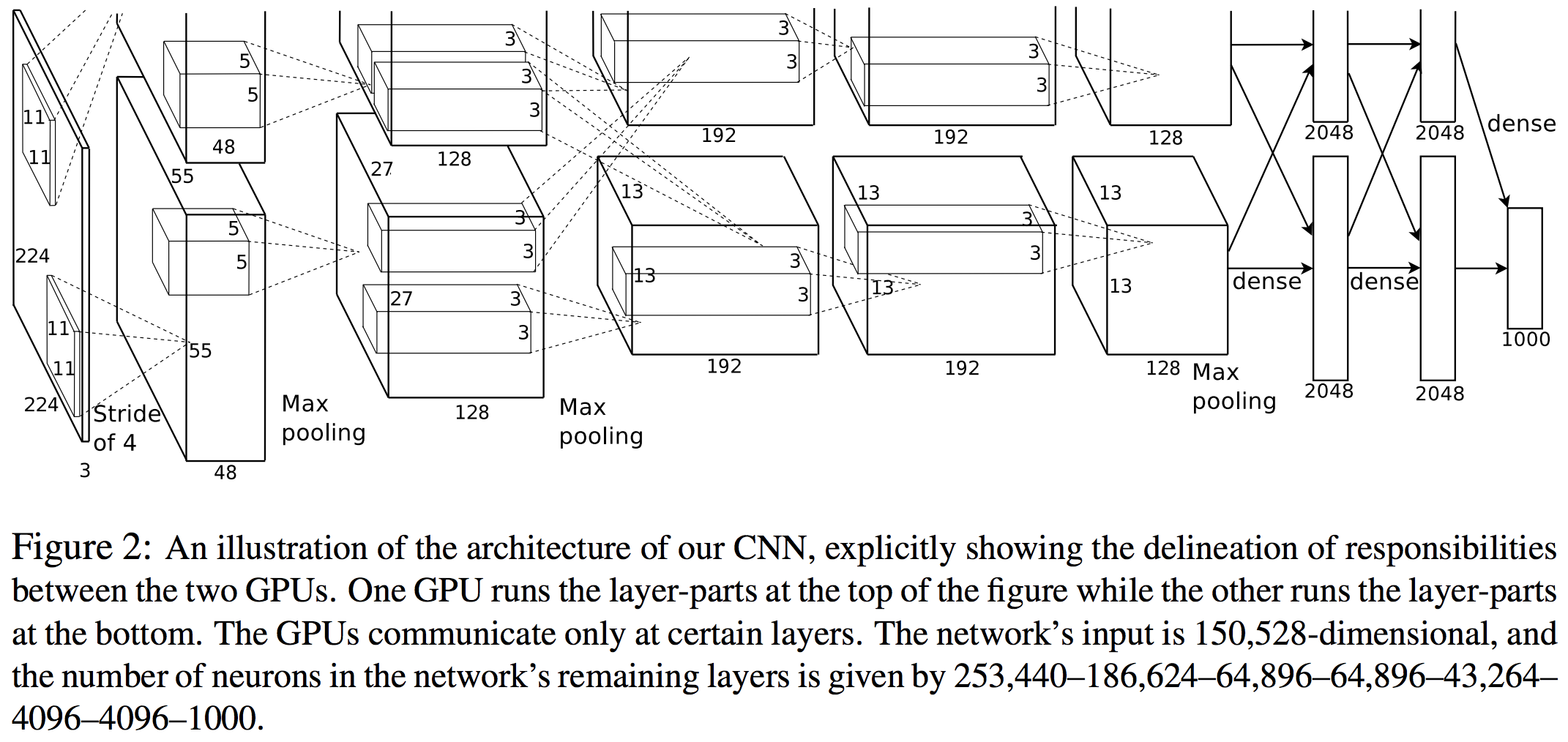

AlexNet は、次の図 (Figure 2, Krizhevsky et al., 2012) のように 3 つの畳み込み層(convolutional layer)、2 つのプーリング層(pooling layer)および 3 つの全結合層(fully connected layer)から構成されている。入力画像は 224 × 224 サイズの正方形であり、出力は 1,000 個の要素を持つ 1 次元のベクトルであり、それぞれ 1,000 個の分類クラスを表している。また、AlexNet では、次図のように、1 枚の正方形の画像を上下半分に分けて、上半分と下半分をそれぞれ 2 つの GPU で学習を進めて、最後の全結合層で結合させている。

2012 年に ILSVRC で 1 位を獲得した AlexNet は、すぐ次の年に他のアーキテクチャに抜かれた。現在では、AlexNet はほとんど使われていない。しかし、AlexNet に初めて取り入れられたいくつかの概念が、その後の画像分類のアーキテクチャの開発に影響を与え、現在の標準技術となっている。AlexNet では、画像分類のために、畳み込み層と複数のニューラルネットワークを繋げた深層学習を取り入れて、ニューラルネットワークの活性化関数として ReLU 関数を採用していた。また、画像データの少なさを解決すべく、既存の画像データを反転したり、回転したりして、画像の水増し(augmentation)が行われていた。さらに、過学習を防ぐために dropout と呼ばれる概念が取り入れられていた。

References

- ImageNet classification with deep convolutional neural networks. NeurIPS. 2012. DOI: 10.1145/3065386